Inhalt Zurück Vor

2 Die Software

Bei der Beschreibung der Software möchte ich mich auf die Erklärung der

Signalverarbeitenden Komponenten beschränken.

2.1 Schwarzweiß - der einfache Teil

Es gibt zwei Anzeigemodi:

- die rohe Ausgabe der Daten (sie werden genau wie sie von der Hardware

kommen dargestellt - evtl. gedithert auf die vorhandenen Grauwerte),

- die auf den gültigen Bildbereich beschränkte, auf 4:3 skalierte,

schwarzwertgeklemmte, kontrastgeregelte und evtl. gefilterte Ausgabe.

Die rohe Ausgabe zeigt dabei auch die Informationen des Fernsehbildes, die sonst

unsichtbar sind. Dies sind im einzelnen:

- die Synchronimpulse (der Bereich "schwärzer als Schwarz") inklusive der

sgn. Vor- und Nachtrabanten der vertikalen Austastlücke

- die vordere und hintere Schwarzschulter der horizontalen Austastlücke -

dieser Bereich ist jetzt nicht schwarz sondern dunkelgrau.

- der Farbträgerburst in der hinteren Schwarzschulter

- Zusatzsignale in der vertikalen Austastlücke (Videotext, VPS und ein paar

Meßsignale)

Die Austastlücke

2.1.1 Die Bildverarbeitungsschritte im einzelnen

Zunächst besteht das Bild aus zwei Halbbildern, die nacheinander eingelesen

und auch nacheinander verarbeitet werden:

- Zentrierung

- oder auch Synchronisation; der Bildausschnitt wird richtig

positioniert, die 896x575 Pixel des Bildes werden aus den 1024x625

Pixeln ausgeschnitten.

- Filterung

- Handelt es sich um ein Farbbild, kann man mittels digitaler

Filter den Farbträger entfernen (siehe dazu das nächste Kapitel).

- Skalierung

- Das Bild wird auf 4:3 (768x575) entzerrt.

- Schwarzwertklemmung

- Der hinteren Schwarzschulter wird der Pegel für

Schwarz entnommen (in der Regel 64), dieser wird von den sichtbaren Pixeln

abgezogen.

- Kontrastregelung

- Der Schwarzwert entspricht 300mV (bezogen auf die

Synchronsignale) des Videosignals. Weiß entspricht dann genau 1V, der

Digitalwert für Weiß wird aus dem Schwarzwert und diesem Verhältnis gebildet (in

der Regel 213). Die Pixel werden dementsprechend auf den Bereich von 0 bis 255

umgerechnet.

2.2 Digitale Filterung

Es gibt zwei Möglichkeiten, den Farbträger (4433593,75Hz bei PAL - das

entspricht einer Periode von ~3,6 Pixeln) aus dem Signal herauszufiltern:

- Eindimensional - der übliche Weg bei einfachen Fernsehgeräten

- Zweidimensional - dieser Weg ist nur mittels digitaler Signalverarbeitung

mit vernünftigen Aufwand zu realisieren

Eindimensionale Filterung im digitalen Videobereich wird in der Regel mittels der

FIR - (finite impule response) - Filter realisiert. Dabei

werden in einer Zeile mehrere benachbarte Pixel mit einem Faktor versehen und

addiert. Die Anzahl der zugrundegelegten Pixel bestimmt die Ordnung des Filters.

- Beispiel

- Einen Tiefpaß realisiert man dabei mit den für alle n Pixel

gleichen Faktor 1/n (das entspricht der Durchschnittsbildung)

Zweidimensionale Filter werden auch Kammfilter genannt. Der Name Kammfilter kommt

von dem kammförmigen Spektrum, das genau dem Spektrum des Farbträgers angepaßt

ist. Ein zweidimensionaler Filter berücksichtigt auch die Pixel der

benachbarten Zeilen (so ist der Farbträger bei PAL gegenüber der vorletzten und

der übernächsten Zeile genau um 180° verschoben). Da die Zeilen dafür

gespeichert werden müssen, erkärt sich damit die Notwendigkeit der digitalen

Signalverarbeitung. Treten nun Farb- oder Helligkeitssprünge von Zeile zu Zeile

auf, so werden diese jetzt verwischt, dieses zu erkennen und auszugleichen ist

die Eigenschaft der sgn. adaptiven Kammfilter, welche von drei Zeilen die nicht

berücksichtigt, die vom Mittelwert allzu stark abweicht.

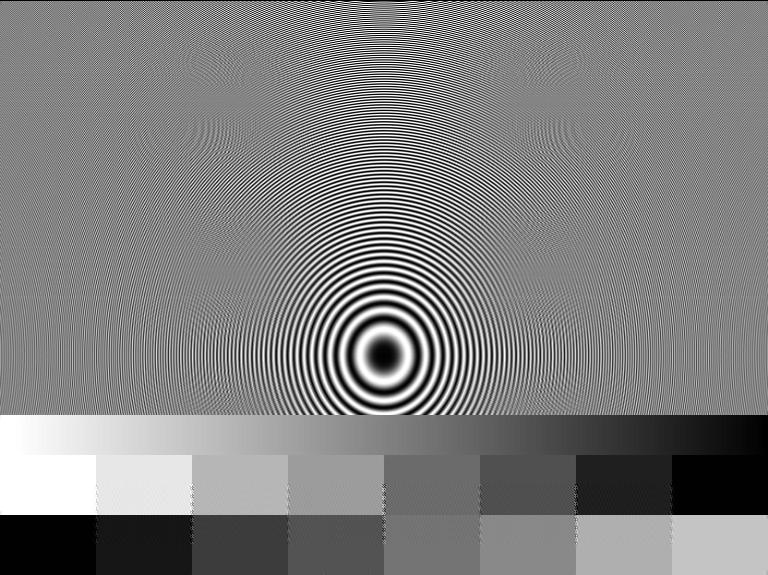

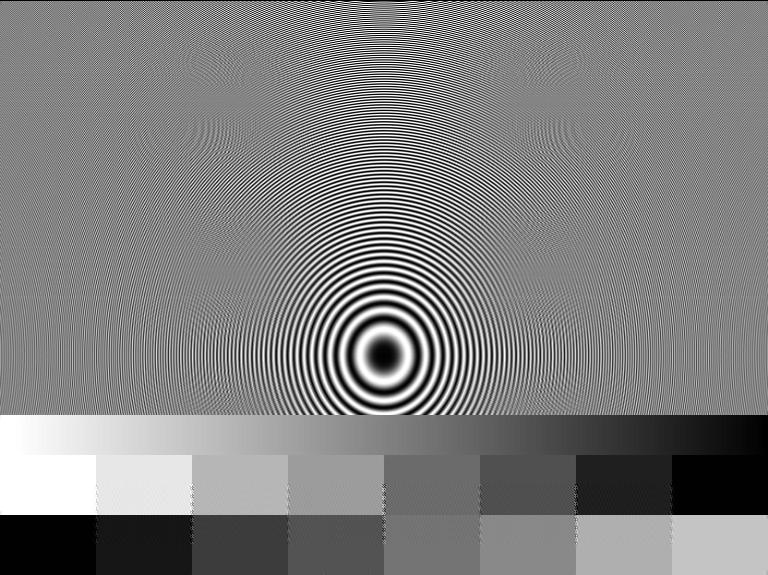

Das Testbild, zweidimensional gefiltert

Das Testbild (die .video-Datei dafür wurde mittels des Programms

ZonePlateStream(.e) erzeugt) enthält neben den obligatorischen Grauwert-

und Farbbalken die sgn. Zonenplatte. Die Zonenplatte hat nun die Eigenschaft,

alle in einem Videosignal möglichen Frequenzen zu enthalten, die derart

angeordnet sind, daß die 2d-Fouriertransformierte wieder eine Zonenplatte

ergibt. die Abbildung zeigt, welche Frequenzen der Kammfilter entfernt.

Der Vorteil ist hierbei, daß senkrechte hochfrequente Strukturen erhalten

bleiben.

Es bleibt noch zu erwähnen, daß das Schwarzweißbild (die Luminaz) sich aus der

Differenz von dem rohen Videosignal und dem herausgefilterten Farbartsignal

(der Chrominanz) ergibt.

2.3 Farbe - der schwierige Teil

Um es vorwegzunehmen, die Qualität der Farbberechnung hängt zu einem Großteil

von der Qualität der Filter ab. Ist der Filter nicht perfekt, werden Luminaz und

Chrominaz nicht sauber voneinander getrennt und es kommt zu Übersprecheffekten.

Abgesehen davon gliedert sich die Farbdekodierung wie folgt:

- Rückgewinnung der Farbträgerphase

- Das Modulationsverfahren ist die

Quadraturamplitudenmodulation, das Signal enthält zwei Komponenten (diese

sind bei PAL U und V), die um 90° versetzt sind. Zur Demodulation ist die

Kenntnis über die Phase nötig. Dazu wird in der horizontalen Austastlücke eine

Referenz gesendet (der Farbträgerburst - ca. 10 Schwingungen mit 135°), mit

der sich der (digitale) Oszillator synchronisieren läßt. Praktisch wird dazu der

Burst normal demoduliert (s.u.) und dann der Phasenfehler ausgeglichen.

- Synchrondemodulation

- Die Farbkomponenten U und V werden aus der

Chrominaz C errechnet:

-

s ist dabei der Faktor, der die Farbsättigung angibt. Er errechnet sich aus

der Amplitude des Farbträgerbursts, dieser ist zu 75% gesättigt und hat in der

Regel eine Amplitide von 20% des Weißwerts (gegebüber Schwarz), also etwa

140mV. Daß die Phase von V von Zeile zu Zeile umgekehrt wird, ist

PAL-Eigenschaft und wird unten erläutert. beta ist nun der Wert des digitalen

Oszillator-Inkrements. Praktisch realisiert wurde dieses mit einer Sinustabelle

mit 4096 Einträgen. Das Inkrement ist bei einer Abtastfrequenz von 16MHz dann

genau 1135.

- Tiefpaßfilterung der Farbkomponenten

- U und V sind jetzt noch mit dem

sin˛-förmigen Farbträger versehen, dieser wird mittels eines (FIR-)

Tiefpaßfilters entfernt.

- PAL-Kompensation

- Um mögliche (prinzipbedingte) Phasenfehler (und somit

Farbverfälschungen) ausgleichen zu können, ist die Phase der V-Komponente

Zeilenweise um 180° verschoben. Hebt man diese Phasenverschiebung beim

dekodieren auf (invertieren jeder zweiten Zeile) und mittelt die U- und

V-Komponenten Zeilenweise, so kompensieren sich gleiche Phasenfehler in den

Zeilen. Da dadurch die Farbauflösung in der Vertikalen halbiert wird, kann man

einen Schwellwert setzen, über dem dieser Mechanismus abgeschaltet wird.

- Dematrizierung

- Aus der Luminanz Y und den Komponeneten U, V

errechnen sich R,G,B wie folgt:

Weiter

![]()